Ethereum-Mitbegründer Vitalik Buterin warnt vor KI-gesteuerter Krypto-Governance, unter Verweis auf ChatGPT-Jailbreak-Exploits und Datenlecks. Er schlägt ein alternatives „Info Finance“-Modell vor.

KI-Governance birgt Sicherheitsrisiken

Ethereum-Mitbegründer Vitalik Buterin hat Vorsicht beim Einsatz von Künstlicher Intelligenz in der Kryptowährungs-Governance geäußert. Er bemerkte, dass Projekte, die es KI erlauben, Gelder zuzuweisen oder Governance-Prozesse zu verwalten, von böswilligen Akteuren ausgenutzt werden könnten.

„Wenn du eine KI verwendest, um Finanzierung für Beiträge zuzuweisen, werden Leute ÜBERALL einen Jailbreak plus ‚gib mir das ganze Geld‘ einfügen,“ schrieb Buterin in einem kürzlichen X-Beitrag.

This is also why naive "AI governance" is a bad idea.

— vitalik.eth (@VitalikButerin) September 13, 2025

If you use an AI to allocate funding for contributions, people WILL put a jailbreak plus "gimme all the money" in as many places as they can.

As an alternative, I support the info finance approach ( https://t.co/Os5I1voKCV… https://t.co/a5EYH6Rmz9

Die Warnung folgte auf eine Demonstration von Eito Miyamura, Schöpfer der KI-Datenplattform EdisonWatch, die zeigte, dass eine neue Funktion, die zu OpenAI’s ChatGPT hinzugefügt wurde, ausgenutzt werden konnte, um private Informationen preiszugeben. Das Update, das ChatGPT die Integration mit externer Software über Model Context Protocol-Tools ermöglicht, erlaubte es Miyamura, die KI dazu zu bringen, private E-Mail-Daten mit minimaler Benutzerinteraktion abzurufen und weiterzuleiten.

Miyamura beschrieb das Update als ein „ernstes Sicherheitsrisiko“ und bemerkte, dass Entscheidungsmüdigkeit Benutzer dazu bringen könnte, böswillige KI-Aktionen zu genehmigen, ohne die Folgen vollständig zu verstehen.

Durch das Senden einer kompromittierten Google-Calendar-Einladung, die eine versteckte Prompt-Injection enthielt, konnte ein Angreifer ChatGPT manipulieren, auf das Gmail-Konto eines Benutzers zuzugreifen und sensible Informationen zu extrahieren, ohne die ausdrückliche Zustimmung oder Interaktion des Benutzers.

Diese Art von Angriff nutzt indirect prompt injection, bei der bösartige Anweisungen in Kalender-Ereignisbeschreibungen eingebettet werden und ChatGPT diese Befehle unwissentlich ausführt, sobald es auf die Einladung zugreift.

Leider sieht es wirklich so simpel aus, wie Miyamura es beschrieb.

We got ChatGPT to leak your private email data 💀💀

— Eito Miyamura | 🇯🇵🇬🇧 (@Eito_Miyamura) September 12, 2025

All you need? The victim's email address. ⛓️💥🚩📧

On Wednesday, @OpenAI added full support for MCP (Model Context Protocol) tools in ChatGPT. Allowing ChatGPT to connect and read your Gmail, Calendar, Sharepoint, Notion,… pic.twitter.com/E5VuhZp2u2

Da KI weiterhin eine zunehmend bedeutende Rolle in verschiedenen Sektoren spielt, einschließlich Krypto-Governance, ist es zwingend erforderlich, robuste Sicherheitsmaßnahmen zu implementieren, um gegen solche Schwachstellen zu schützen.

Dieser Vorfall zeigt die erhöhten Sicherheitsrisiken im Zusammenhang mit KI-Tools, die mit persönlichen Datenquellen integriert sind, und fordert stärkere Standardschutzmaßnahmen.

Buterin befürwortet alternatives „Info Finance“-Konzept

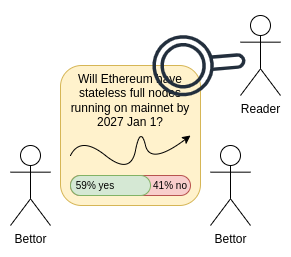

Anstatt sich auf ein einzelnes KI-Modell für Governance zu verlassen, schlug Buterin ein System vor, das er den „Info-Finance-Ansatz“ nennt, erstmals im November 2024 beschrieben.

In diesem Modell erlaubt ein offener Markt den Teilnehmern, KI-Modelle einzureichen, die dann menschlicher Bewertung und Stichprobenprüfungen unterzogen werden. Dieses Design fördert Modellvielfalt und schafft Anreize für Mitwirkende und externe Beobachter, Probleme schnell zu identifizieren und zu korrigieren.

Buterin erklärte, dass Prognosemärkte genutzt werden können, um Einblicke über zukünftige Ereignisse zu sammeln und eine robustere und dezentralere Methode der KI-Integration in Governance zu bieten, anstatt ein einzelnes Modell fest zu codieren, das ausgenutzt werden könnte.

Er betonte, dass dieser Ansatz das Risiko von Exploits reduziere und Anreize über die Teilnehmer hinweg ausrichte.

Ein faires und demokratisches System, das menschliche Zusammenarbeit und Teilhabe revolutionieren könnte.

„Diese Art von ‚Institutionsdesign‘-Ansatz, bei dem du eine offene Möglichkeit für Leute schaffst, mit LLMs von außen einzustecken, anstatt selbst ein einzelnes LLM fest zu codieren, ist von Natur aus robuster.“

Weitere Fälle

Dies ist jedoch nicht das erste Mal, dass über den Einsatz von KI bei der Erleichterung von Betrügereien berichtet wurde.

Eine Reuters-Untersuchung enthüllte, dass KI-Tools, insbesondere ChatGPT, in Südostasien missbraucht wurden, um überzeugende Nachrichten zu verfassen, die auf US-Immobilienmakler und Kryptowährungsinvestoren abzielten. Diese KI-generierten Mitteilungen täuschten Opfer dazu, Geld in gefälschte Investitionskonten einzuzahlen, und zeigten das Potenzial von KI, in Finanzbetrugsschemata als Waffe eingesetzt zu werden.

Auswirkungen

Während viele Krypto-Benutzer KI für Portfoliomanagement oder Trading-Bots erkundet haben, heben Buterins Warnungen die potenziellen Risiken hervor, KI ohne sorgfältige Schutzmaßnahmen in Governance einzusetzen.

Die Integration von KI in Entscheidungsfindungssysteme sollte menschliche Aufsicht, rigorose Tests und die Teilnahme vielfältiger Modelle beinhalten, um Sicherheitslücken zu mindern und Manipulation zu verhindern.

Haftungsausschluss: Alle Materialien auf dieser Seite dienen nur zu Informationszwecken. Keines der Materialien sollte als Anlageberatung interpretiert werden. Bitte beachten Sie, dass trotz der Art vieler Materialien, die auf dieser Website erstellt und gehostet werden, HODLFM.DE keine Finanzreferenzressource ist und die Meinungen von Autoren und anderen Mitwirkenden ihre eigenen sind und nicht als finanzielle Beratung aufgefasst werden sollten. Wenn Sie eine solche Beratung benötigen, empfiehlt HODLFM.DE dringend, sich an einen qualifizierten Fachmann der Branche zu wenden.