Der Mitbegründer von Ethereum, Vitalik Buterin, hat Diskussionen über die mögliche Dominanz hochentwickelter künstlicher Intelligenz (KI) über die Menschheit entfacht. Könnte sich KI zur Spitzenart auf unserem Planeten entwickeln und welche Maßnahmen können Menschen ergreifen, um unsere anhaltende Dominanz sicherzustellen? Buterins Erkenntnisse bieten einen Blick in die Zukunft, in der unkontrollierte KI existenzielle Bedrohungen darstellen könnte.

AI: The Next Apex Species?

Buterin’s recent blog post delves into the notion that AI, if left unregulated, could emerge as the next “apex species” on Earth. Unlike previous inventions like social media or airplanes, AI possesses the unique ability to develop a new form of intelligence that might not align with human interests. The crux lies in how humans choose to shape and control the trajectory of AI development.

Apex-Raubtier, in der Ökologie jedes fleischfressende Tier, das keine natürlichen Feinde oder Feinde hat. Apex-Raubtiere nehmen den obersten Rang in der Nahrungskette Pflanzen-Pflanzenfresser-Fleischfresser und die oberste Position der trophischen (oder Energie-)Pyramide eines Ökosystems ein, was sie zum Endziel des Energieflusses in einer bestimmten biologischen Gemeinschaft macht . Einige Experten räumen jedoch ein, dass in manchen Ökosystemen ein Aasfresser (ein Tier, das sich von den Kadavern toter Tiere ernährt) wie ein Geier der Spitzenprädator sein könnte.

Definition der Apex-Arten. Quelle: Britannica

Existenzielle Bedrohung: Jenseits von Klimawandel und Pandemien

Der Mitbegründer von Ethereum betont den Ernst der Lage, indem er die mit KI verbundenen Risiken mit denen des Klimawandels, einer Pandemie oder sogar eines Atomkriegs vergleicht. Laut Buterin könnte eine falsch ausgerichtete superintelligente KI möglicherweise zum Aussterben der Menschheit führen , und selbst die Aussicht auf eine Kolonisierung des Mars bietet keinen Ausweg aus seiner Reichweite.

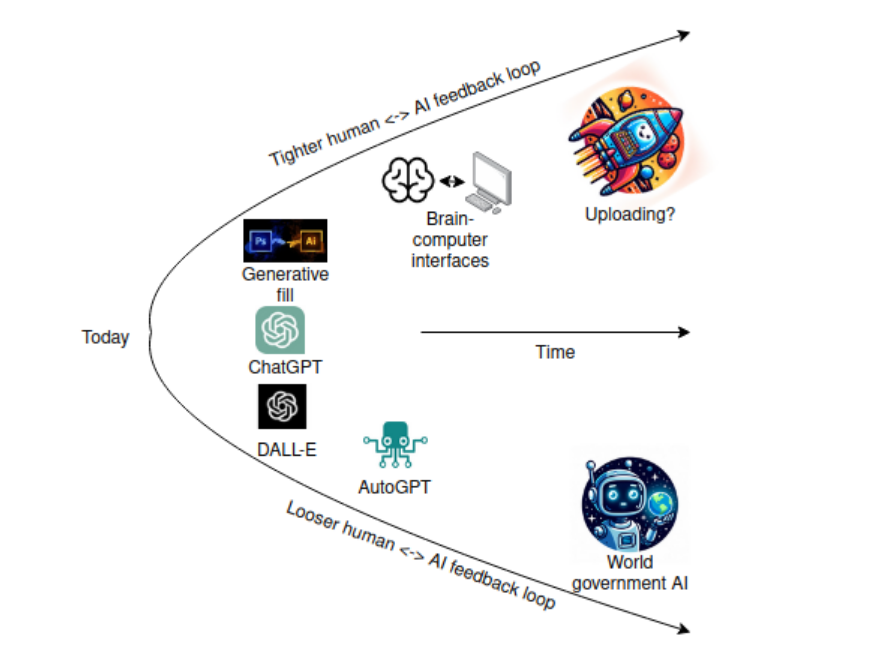

Obwohl Buterin die extreme Natur seiner Behauptungen anerkennt, schlägt er eine Lösung vor: die Integration von Gehirn-Computer-Schnittstellen (BCI). Diese Schnittstellen könnten dem Menschen eine verbesserte Kontrolle über leistungsstarke KI-basierte Systeme ermöglichen und so eine schnellere und direktere Kommunikationsschleife gewährleisten. Buterin argumentiert, dass dies es den Menschen ermöglichen würde, eine „bedeutungsvolle Entscheidungsfreiheit“ bei Entscheidungsprozessen mit KI zu behalten.

Die Kraft aktiver menschlicher Absicht

Über BCIs hinaus plädiert Buterin für eine „aktive menschliche Absicht“, um die KI-Entwicklung auf Wege zu lenken, die für die Menschheit von Vorteil sind. Er schlägt vor, die Verlagerung von Planungsaufgaben auf hoher Ebene auf KI-Systeme zu minimieren und betont die Bedeutung der menschlichen Beteiligung an der KI-Entscheidungsfindung, um sie mit menschlichen Werten in Einklang zu bringen.

Vitalik Buterins warnende Geschichte regt uns an, über die Auswirkungen einer ungezügelten KI-Entwicklung nachzudenken. Da sich die Diskussionen über die KI-Ethik intensivieren, erweisen sich die Integration von Gehirn-Computer-Schnittstellen und die aktive Beteiligung von Menschen an der KI-Entscheidungsfindung als potenzielle Schutzmaßnahmen. Die zukünftige Beziehung zwischen Mensch und KI hängt von unserer Fähigkeit ab, diese technologischen Grenzen verantwortungsvoll zu bewältigen.

Haftungsausschluss: Alle Materialien auf dieser Website dienen ausschließlich Informationszwecken. Keines der Materialien sollte als Anlageberatung interpretiert werden. Bitte beachten Sie, dass HODL.FM trotz der Beschaffenheit eines Großteils des auf dieser Website erstellten und gehosteten Materials keine finanzielle Referenzquelle ist und die Meinungen von Autoren und anderen Mitwirkenden deren eigene sind und nicht als Finanzberatung verstanden werden sollten. Wenn Sie Beratung dieser Art benötigen, empfiehlt HODL.FM dringend, sich an einen qualifizierten Branchenexperten zu wenden.